IA : un premier pas vers des résolutions éthiques internationales

42 pays adhèrent à la norme intergouvernementale élaborée par l’OCDE en vue d’assurer le développement d’une intelligence artificielle « de confiance ».

Le développement de l’IA, une question de confiance ?

Cette notion est au cœur de lignes directrices que la Commission européenne a publiées le mois dernier.

Elle est tout aussi centrale à la « recommandation sur l’intelligence artificielle » adoptée ce 22 mai 2019 par le Conseil de l’OCDE.

42 pays, dont les 36 membres de l’organisation internationale, adhèrent aux principes qu’énonce le document.

Ces principes, juridiquement non contraignants, sont au nombre de cinq. Les parties prenantes au cycle de vie des systèmes d’IA* sont appelés à les mettre en œuvre.

Le premier d’entre eux prône « croissance inclusive, développement durable et bien-être ». Y sont listés, parmi les objectifs souhaitables, le renforcement de la créativité humaine, l’inclusion des populations sous-représentées et la protection des milieux naturels.

Les quatre autres principes abordent les questions d’équité, de transparence et de robustesse des systèmes d’IA, ainsi que la responsabilité de ceux qui interviennent dans leur cycle de vie.

S’y assortissent cinq recommandations vouées à guider l’élaboration des politiques nationales et la coopération internationale. Il y est essentiellement question de stimuler les investissements, de façonner un cadre d’action favorable et de préparer la transformation de la société.

* L’OCDE définit un « système d’IA » comme capable, pour un ensemble d’objectifs donnés par l’homme, d’établir des prévisions, de formuler des recommandations ou de prendre des décisions influant sur des environnements réels ou virtuels.

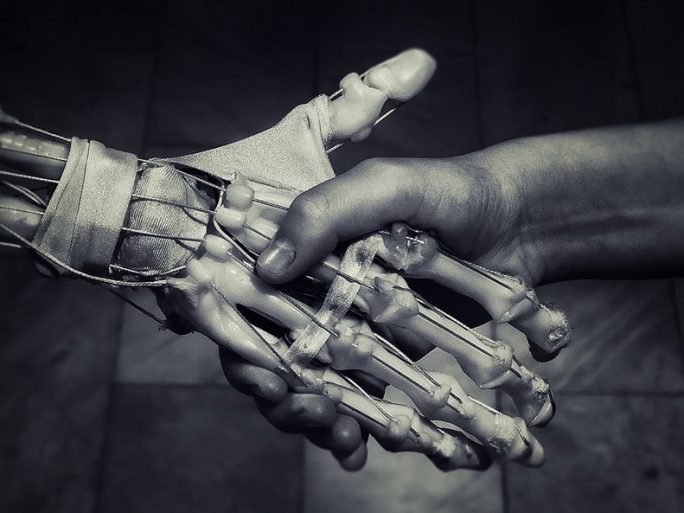

Photo d’illustration © Peter Kurdulija via VisualHunt.com / CC BY-NC-ND